Oral history en digitaal erfgoed: stemmen uit het verleden ontsluiten

Strategieën voor transcriptie, metadata en privacy in moderne archieven

Het verzamelen en bewaren van gesproken verhalen, ook wel oral history genoemd, vormt een onmisbare schakel in onze collectieve geschiedschrijving. Waar traditionele archieven eeuwenlang gedomineerd werden door papieren documenten en aktes, zien we de laatste decennia een exponentiële groei in audiovisueel materiaal. Musea, historische verenigingen en gemeentearchieven beheren inmiddels duizenden uren aan interviews die de tijdgeest van de twintigste en eenentwintigste eeuw vangen.

De grote uitdaging van dit moment ligt echter niet langer in de fysieke opslag of digitalisering van de dragers, maar in de inhoudelijke ontsluiting ervan. Een digitaal audiobestand is in feite een gesloten doos; zonder adequate transcriptie en verrijking met metadata blijft de inhoud onzichtbaar voor zoekmachines en onderzoekers.

Deze waardevolle getuigenissen dreigen hierdoor te veranderen in digitaal oud ijzer: veilig opgeborgen in een depot, maar feitelijk ontoegankelijk voor het publiek dat er recht op heeft. In dit artikel verkennen we hoe moderne technologie, wetgeving en archivistiek samenkomen om deze stemmen niet alleen te bewaren, maar ook daadwerkelijk te laten spreken in een digitale omgeving.

Van audiobestand naar doorzoekbare data

De unieke kracht van oral history schuilt in de onvervangbare nuance van de menselijke stem. Intonatie, betekenisvolle stiltes, regionale dialecten en emotionele lading vertellen vaak een dieper verhaal dan de letterlijke tekst op papier ooit zou kunnen overbrengen. Voor erfgoedinstellingen is het vastleggen van ooggetuigenverslagen bij historische gebeurtenissen dan ook een kerntaak geworden. Deze interviews bieden een zeldzaam perspectief van onderop dat in officiële beleidsstukken of krantenartikelen vaak ontbreekt. Toch worstelen beheerders van deze collecties met een fundamenteel probleem dat de bruikbaarheid ernstig beperkt: de **doorzoekbaarheid).

Audio is van nature een lineair medium. Om te weten wat er in een opname van twee uur precies wordt besproken, moet een onderzoeker in de traditionele situatie de volledige band beluisteren. Dit maakt het verifiëren van feiten of het zoeken naar specifieke thema's een uiterst tijdrovende bezigheid. Een collectie van duizenden uren aan interviews verandert hierdoor onbedoeld in een ondoorschijnend archief. De verhalen zijn weliswaar veiliggesteld voor de eeuwigheid, maar blijven in de praktijk onvindbaar voor journalisten, studenten of familieleden. De sleutel tot werkelijke ontsluiting ligt in de transformatie van geluid naar tekst en gestructureerde data. Pas wanneer het gesproken woord is omgezet in een nauwkeurig en doorzoekbaar transcript, kunnen onderzoekers met trefwoorden diep in de materie duiken. Hierdoor verandert een statisch audiobestand in een dynamische bron voor historische analyse en educatieve projecten.

Technische uitdagingen en taalvariatie

Bij het digitaliseren en transcriberen van erfgoedcollecties stuiten projectleiders op specifieke technische en taalkundige drempels die in de reguliere zakelijke markt minder frequent voorkomen. Veel oral history projecten bestaan uit opnames die tientallen jaren geleden zijn gemaakt op analoge dragers zoals cassettebandjes, minidiscs of spoelenbanden. De tand des tijds heeft vaak invloed gehad op de geluidskwaliteit, resulterend in achtergrondruis, bromtonen of variaties in volume die het transcriptieproces aanzienlijk bemoeilijken. Daarnaast is het taalgebruik in historische interviews zelden **standaardnederlands).

Regionale dialecten, verouderde uitdrukkingen, sociolecten en 'code-switching' tussen streektalen en het Nederlands vormen de kern van de authenticiteit van het materiaal. Tegelijkertijd vormen deze nuances een groot struikelblok voor generieke spraakherkenningssoftware die getraind is op modern kantoortaalgebruik. Voor een correcte weergave is het noodzakelijk dat de transcriptie niet alleen de klanken herkent, maar ook de historische en culturele context begrijpt. Binnen de erfgoedsector woedt bovendien een voortdurende discussie over de weergavevorm: kiest men voor een woordelijke transcriptie of een leesbare editie? Bij een woordelijke weergave worden ook alle haperingen, herhalingen en tussenwerpsels vastgelegd, wat voor taalkundig onderzoek van groot belang is. Voor historische ontsluiting volstaat vaak een leesbare weergave die de essentie behoudt zonder de lezer te vermoeien. De inzet van geavanceerde technologie die specifiek getraind is op de Nederlandse taalvariëteiten is hierbij onmisbaar om de enorme hoeveelheid materiaal te verwerken tot een solide basis, die vervolgens door menselijke experts kan worden verfijnd.

Privacy, AVG en ethische kaders

Een aspect dat bij de ontsluiting van interviews absolute prioriteit heeft boven snelheid of techniek, is de juridische en ethische borging van privacy. Oral history raakt per definitie aan persoonsgegevens. Het gaat daarbij niet alleen om de gegevens van de geïnterviewde zelf, maar ook om de namen, relaties en gebeurtenissen van derden die in de verhalen worden genoemd. De Academische integriteit en transcriptie van data, inclusief de Algemene Verordening Gegevensbescherming (AVG), stelt strenge eisen aan het verwerken, opslaan en openbaar maken van deze informatie. Zeker wanneer interviews raken aan politieke overtuigingen, religie, gezondheid of seksuele geaardheid, is er sprake van bijzondere persoonsgegevens die extra bescherming genieten.

Het simpelweg online plaatsen van integrale interviews en transcripties is zelden toegestaan zonder expliciete, geïnformeerde toestemming. Erfgoedinstellingen werken daarom met quitclaims of overdrachtsformulieren waarin de verteller nauwkeurig aangeeft wat er met het materiaal mag gebeuren. Een complex vraagstuk ontstaat bij oudere collecties waarvoor deze toestemming in het verleden niet expliciet is vastgelegd, of waarbij de afspraken uit het pre-internettijdperk stammen. In dergelijke gevallen is een zorgvuldige belangenafweging nodig tussen het historisch belang en de privacy van betrokkenen. Anonimisering of pseudonimisering van transcripties biedt vaak een uitkomst om de inhoud beschikbaar te maken voor onderzoek zonder de rechten van individuen te schenden. Daarnaast speelt het auteursrecht op het gesproken woord een rol: de spreker blijft in beginsel eigenaar van zijn verhaal. Bij de verwerking van deze data is het cruciaal dat de gebruikte systemen voldoen aan de hoogste veiligheidsstandaarden. Het verwerken van gevoelige levensverhalen vereist servers die zich binnen de Europese Economische Ruimte bevinden en leveranciers die transparant zijn over hun dataverwerking. Het risico van datalekken moet tot een absoluut minimum worden beperkt om het vertrouwen van de vertellers en hun nabestaanden niet te beschamen.

Metadata en de FAIR principes

Om een collectie daadwerkelijk duurzaam toegankelijk en herbruikbaar te maken, is meer nodig dan alleen het audiobestand en een uitgeschreven tekst. De echte toegevoegde waarde voor de toekomst zit in de metadata. Metadata zijn de gegevens over de gegevens: wie spreekt er, wanneer is het opgenomen, wat is de exacte locatie en wat zijn de kernonderwerpen? In de internationale archiefwereld wordt gewerkt volgens de FAIR principes: data moet Findable, Accessible, Interoperable en Reusable zijn. Een accurate transcriptie fungeert als een rijke bron voor het genereren van deze metadata.

Door middel van automatische analyse kunnen trefwoorden, genoemde personen (Named Entities) en geografische locaties uit de tekst worden gefilterd en als gestructureerde tags aan het bestand worden gekoppeld. Dit maakt het mogelijk om dwarsverbanden te leggen tussen verschillende collecties die voorheen als eilanden functioneerden. Een onderzoeker die geïnteresseerd is in de wederopbouw van Rotterdam kan via deze metadata direct navigeren naar relevante fragmenten in honderden verschillende interviews, zonder elk gesprek integraal te hoeven beluisteren. Standaarden zoals Dublin Core of ISAD(G) zorgen ervoor dat deze beschrijvingen uniform zijn en uitgewisseld kunnen worden tussen verschillende erfgoedplatformen en netwerken. Het verrijken van interviews met tijdsmarkeringen is een andere cruciale stap in dit proces. Hierdoor kan een gebruiker in het digitale archief direct naar de juiste minuut en seconde springen waar een specifiek onderwerp wordt besproken. Deze granulariteit verandert een statisch archiefstuk in een dynamisch onderzoeksinstrument. Het correct en rijk inrichten van deze metadatastructuur aan de voorkant van het digitaliseringsproces bespaart in latere stadia honderden uren aan correctiewerk en zoektochten.

Hybride werkwijze in de praktijk

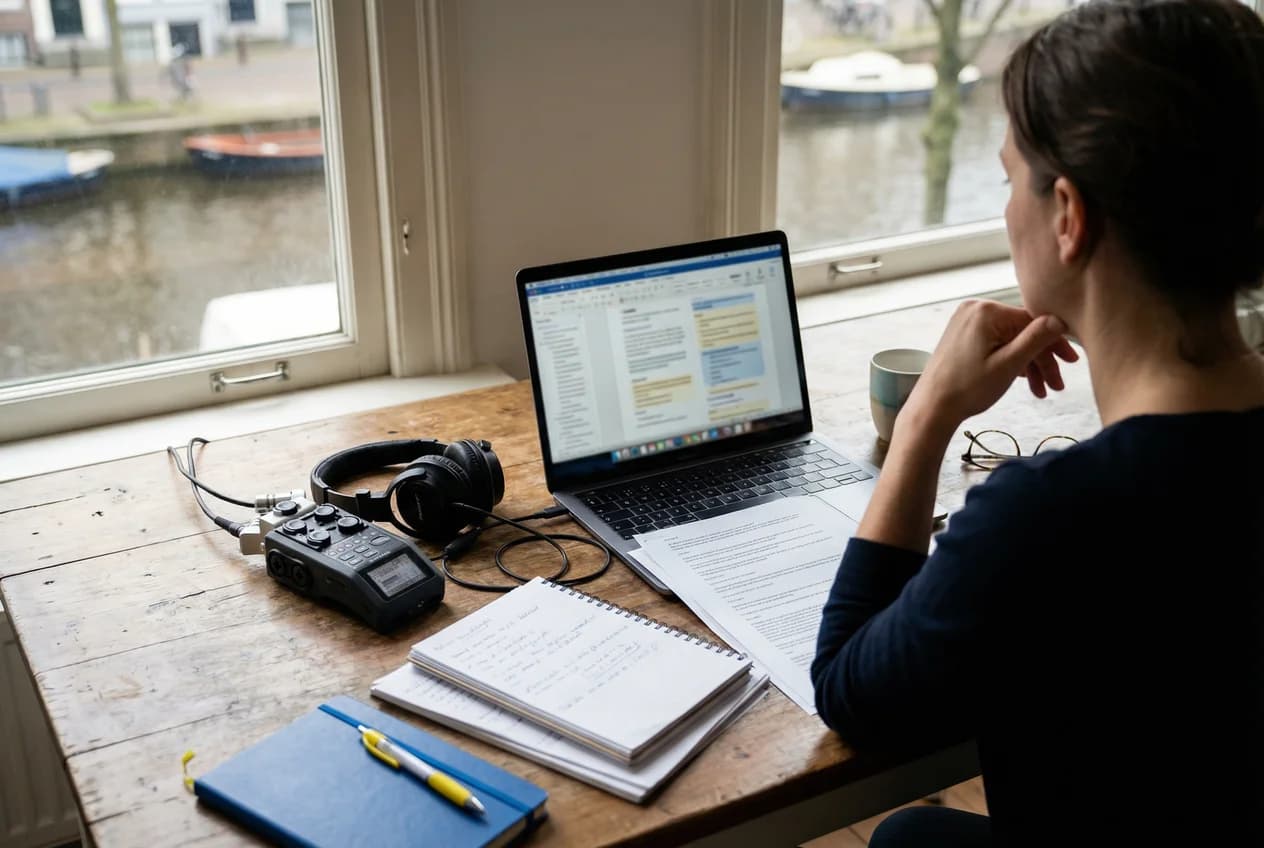

De theorie klinkt veelbelovend, maar laten we kijken naar een concreet voorbeeld van hoe dit proces in de praktijk werkt bij een middelgrote erfgoedinstelling. Stel dat een regionaal archief een project start rondom de verdwenen textielindustrie in Twente of Brabant. De instelling beschikt over vijfhonderd uur aan interviews die in de jaren negentig zijn afgenomen met voormalige fabrieksarbeiders en opzichters. Volledig handmatige transcriptie door vrijwilligers zou bij een gemiddelde snelheid van vijf tot zes uur werk per uur audio neerkomen op minimaal 2500 tot 3000 manuren. Dit is voor de meeste instellingen budgettair en organisatorisch onhaalbaar.

De oplossing ligt in een slim hybride model waarin mens en machine samenwerken. De audiobestanden worden eerst door gespecialiseerde software omgezet in een ruw transcript. Dankzij specifieke training op Nederlandse accenten wordt een groot deel van het dialect en het jargon correct herkend. Vervolgens komen de vrijwilligers in beeld, maar hun rol verandert fundamenteel. Hun taak verschuift van het volledig uittypen naar het controleren en corrigeren van de gegenereerde tekst. Zij voegen specifieke vakkennis toe over namen van machines, lokale bijnamen van opzichters en geografische details die de software mogelijk heeft gemist. Deze werkwijze reduceert de benodigde tijd per uur audio met wel tachtig tot negentig procent. Het resultaat is niet alleen een snellere ontsluiting, maar ook een hogere tevredenheid onder de vrijwilligers. Zij kunnen zich richten op de inhoudelijke duiding en verrijking in plaats van het geestdodende repetitieve typwerk. De uiteindelijke transcripties worden samen met de audio en de verrijkte metadata opgenomen in het collectiebeheersysteem, waardoor de verhalen over de textielindustrie voor de eeuwigheid bewaard blijven.

Toekomstbestendig beheer en preservering

De duurzame opslag van deze digitale bestanden vereist een langetermijnvisie die verder kijkt dan de technologie van vandaag. Bestandsformaten verouderen en digitale dragers kunnen vergaan door 'bit rot'. Waar mp3 gangbaar is voor snelle consumptie, kiezen archieven voor preservering vaak voor 'lossless' formaten zoals WAV of FLAC. Deze formaten garanderen dat er geen informatie verloren gaat door compressie. Voor de tekstuele component, de transcriptie, is het van belang om open standaarden te gebruiken zoals XML of PDF/A. Deze formaten zijn systeem onafhankelijk en naar verwachting ook over vijftig jaar nog leesbaar door computers.

De koppeling tussen het audiofragment en het tekstbestand moet robuust zijn, zodat bij een onvermijdelijke migratie naar een nieuw collectiebeheersysteem de link tussen woord en geluid niet verbroken wordt. Erfgoedinstellingen moeten daarnaast rekening houden met de exponentiële groei van data en de voortdurende ontwikkeling van AI. Naarmate taalmodellen beter worden in het herkennen van dialecten en context, kan het interessant zijn om oude collecties over vijf of tien jaar opnieuw te verwerken voor een nog nauwkeuriger resultaat. Dit betekent dat het proces van ontsluiting nooit echt af is, maar een cyclisch karakter heeft. Het beleid moet erop gericht zijn om flexibel in te spelen op nieuwe technologische mogelijkheden, zonder de integriteit van het originele bronmateriaal uit het oog te verliezen. Het uiteindelijke doel blijft onveranderd: het levend houden van de menselijke ervaringen die onze geschiedenis kleuren. Door slim gebruik te maken van technologie verschuift de focus van de archivaris van puur passief beheer naar actieve valorisatie en presentatie van de collectie.

Conclusie: de archivaris als regisseur

De transformatie van oral history en ander erfgoedmateriaal naar digitaal toegankelijke bronnen is een complex speelveld waarin techniek, ethiek, juridische kaders en geschiedenis samenkomen. De tijd dat unieke audio-interviews stof lagen te happen in een magazijn is definitief voorbij; de vraag naar directe, digitale toegang vanuit de samenleving is daarvoor te groot. De moderne archivaris en erfgoedprofessional heeft de taak om als regisseur op te treden in dit digitaliseringsproces. Door de juiste balans te vinden tussen automatisering en menselijke validatie, kunnen collecties die decennialang zwegen weer een stem krijgen in het publieke debat en wetenschappelijk onderzoek.

Dit vraagt om specifieke kennis van privacywetgeving, een diep begrip van metadatastandaarden en de durf om nieuwe tools te integreren in bestaande, vaak traditionele workflows. De culturele winst is groot: persoonlijke verhalen die anders verloren zouden gaan, worden een onlosmakelijk en doorzoekbaar onderdeel van ons collectieve digitale geheugen. Voor instellingen die grote hoeveelheden gesproken woord willen ontsluiten, biedt de huidige generatie spraaktechnologie ongekende mogelijkheden om deze inhaalslag te maken. Het inzetten van een platform als RecapAI, dat specifiek is ingericht op de nuances van de Nederlandse taal en strenge Europese privacy-eisen, kan dit proces aanzienlijk versnellen en beveiligen. Zo blijft er bij de erfgoedprofessional meer tijd en budget over voor waar het echt om draait: het duiden, cureren en doorgeven van ons gedeelde verleden.